Ученые исследуют риски для человечества, связанные с созданием ИИ

«Постройку Скайнета одобрят. Система войдет в строй четвертого августа 1997 года. Решения людей будут изолированы от влияния на cтратегическую оборону. Скайнет начнет учиться в геометрической прогрессии и осознает себя в 2:14 утра по восточному времени 29 августа 1997 года. Затем Скайнет нанесет ядерный удар по целям в России». Терминатор 2: Судный День.

Хотя этот вымышленный сценарий и не осуществился в 1997 году, ученые из Кембриджского университета считают, что нельзя терять бдительность — в будущем Скайнет может оказаться вполне себе реальной угрозой.

Именно поэтому команда ученых, философов и инженеров сформируют исследовательскую группу, которая будет работать в новом Центре изучения рисков для существования человечества (Centre for the Study of Existential Risk, CSER) в Кембриджском университете, расположенном в Великобритании.

Рабочая группа займется изучением и отслеживанием ключевых разработок в области искусственного интеллекта, предупреждением потенциальных угроз и их негативного влияния на человечество.

Шахматный матч Гарри Каспарова с компьютером IBM Deep Blue, в котором победил компьютер

Компьютеры, уже сейчас намного превосходящие по многим параметрам мозг среднестатистического человека (например, надежность и точность арифметических вычислений, а также производительность), пока не умеют «мыслить» самостоятельно, но все в этом мире возможно, в том числе нельзя исключить возможность разработки технологии, позволяющей машине самостоятельно создавать новые программы и совершенствовать саму себя (симбиоз так называемого «машинного обучения» и «машинного творчества»).

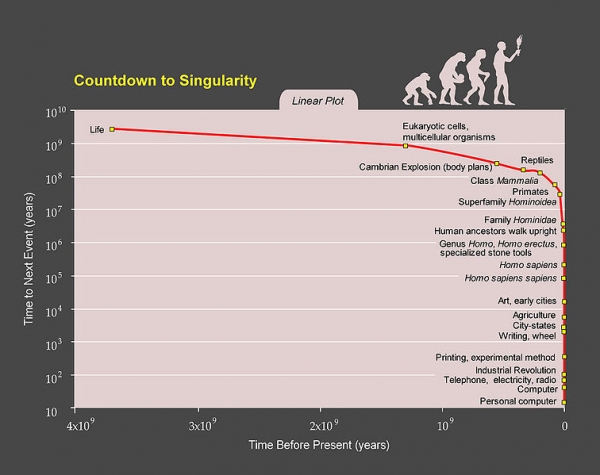

Ускорение эволюции — сначала биологической, а затем и технологической

Еще в 1965 году математик, криптограф и специалист в области теории вычислительных машин и систем Джон Ирвинг Гуд (Irving John «Jack» Good) предположил, что в один прекрасный день машины станут достаточно «умными», чтобы делать себя еще умнее и открывать новые способы самосовершенствования без вмешательства человека. В таком случае машина в своем развитии может оставить человека далеко позади и стать наивысшей формой существования.

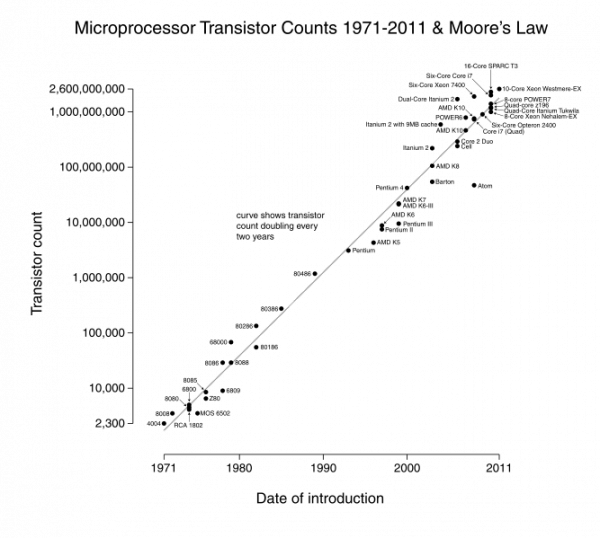

Закон Гордона Мура — количество транзисторов в процессорах удваивается каждые два года

Джон назвал свою гипотезу «теорией интеллектуального взрыва», а другие авторы, подхватившие и развившие ее — «технологической сингулярностью». Как мы знаем, она стала широко известной и популярной в современной научной фантастике.

Titan — самый мощный суперкомпьютер в мире

Хьюв Прайс (Huw Price), профессор Кембриджского университета, описывает этот момент как «выход интеллекта за биологические рамки», другими словами, приход искусственного интеллекта станет моментом, когда человечество перестанет быть наиболее разумным существом в исследованной им части вселенной и перестанет быть главным фактором, определяющим будущее.

http://www.youtube.com/watch?v=chPanW0QWhA

Робот Cheetah от Boston Dynamics

Что интересно, потенциальная угроза от искусственного интеллекта не обязательно может выражается в проявлении враждебной агрессии. Прайс здесь приводит простой пример — уменьшение популяции многих животных, которое вызвано не враждебностью человека по отношению к животным а тем фактом, что человек, став доминирующим существом, начал менять окружающий его мир под себя, и этот мир не всегда подходит для процветающей жизни менее развитых существ.

Антропоморфный самобалансирующийся робот Petman от той же компании

То есть, человечество оказывает негативное влияние на менее развитые организмы непреднамеренно, благодаря своему эгоизму, но эгоизму без злого умысла. Будучи более интеллектуально развитым, искусственный интеллект может создать такую же связь между собой и человеком.

http://www.youtube.com/watch?v=mclbVTIYG8E

Petman в действии

Что же касается приблизительных временных рамок, в которых будет создан ИИ, то такой информацией пока не обладает никто, хотя в мире можно наблюдать взрывообразный рост интереса к сопряженным с ИИ технологиям.

К примеру, у человечества заметно обострилось желание и потребность вести разработки в области интеллектуальных алгоритмов систематизации и поиска (да-да, тот же Google), распознавания образов (компьютерное зрение), лингвистического и семантического анализа и последующей генерации контента (всяческие системы машинного перевода и анализа текстов, а также цифровые помощники вроде Siri) и самообучающихся машин.

В прошлом году ученые из Массачусетского технологического института (Massachusetts Institute of Technology, MIT) провели интересный эксперимент по изучению возможностей компьютера в понимании естественного человеческого языка.

В тесте двум машинам предоставили две разные инструкции (два обычных руководства пользователя) и поставили две разные задачи, которые нужно было решить без помощи человека, опираясь лишь на текст инструкции.

Civilization II от Сида Мейера

Задачей первой машины была самостоятельная установка самой обычной программы в операционной системе. Задачей второй машины было научиться играть в стратегическую игру Civilization II от Сида Мейера (многим нашим читателям, она, конечно же, известна). В серии тестов с первой задачей машина справилась на 80%, тогда как в процессе выполнения второй задачи машина выигрывала в 79% случаев, что является очень хорошим результатом.

И это только один пример — подобных исследований в наши дни проводится очень много. Практически все места обитания человека в наши дни буквально «нашпигованы» процессорными чипами, производительность которых удваивается каждые два года, практически все области жизнедеятельности человечества уже плотно интегрированы с информационными технологиями и спрос на подобные исследовательские программы лавинообразно растет.

Как бы то ни было, искусственный интеллект не рассматривается в наши дни как серьезная проблема, а само это выражение до сих пор относится людьми больше к научной фантастике. Отчасти это происходит из-за фрагментации и неупорядоченности технологий, части которой разрабатываются в рамках отдельных исследований, отчасти — благодаря поп-культуре.

Задачей команды CSER будет «заприметить слона», собрав полную картину потенциально опасных перспективных разработок воедино. Тем не менее, ученые будут сконцентрированы не только на предотвращении Skynet-подобной катастрофы, но будут отслеживать и прочие опасные направления современных научных изысканий. В поле интереса попадут разработки в области био- и нанотехнологий, а также выяснение возможных негативных эффектов резкого глобального изменения климата.

Создание и работу CSER будут финансировать частные инвесторы — профессора Кембриджского университета Хьюв Прайс и Мартин Рис (Martin Rees), наряду с Йаном Таллином (Jaan Tallinn), одним из создателей популярного сервиса интернет-телефонии Skype. Свою работу CSER начнет уже в 2013 году.

Конечно, CSER не станут супергероями-Мстителями из одноименного фильма, и не стоит паниковать, срочно закупаясь спичками, аккумуляторами и патронами. Однако в любом случае с учреждением подобных организаций (к слову, CSER — не первая такая организация, до нее был создан институт Singularity) жизнь стремительно развивающегося человечества станет чуть-чуть безопаснее и спокойнее, что тоже имеет смысл.

![]() iPhone 17 Pro получит уникальную систему охлаждения: что известно о новом флагмане

iPhone 17 Pro получит уникальную систему охлаждения: что известно о новом флагмане

![]() Прорыв в медицине: мужчина прожил более 100 дней с полностью искусственным сердцем

Прорыв в медицине: мужчина прожил более 100 дней с полностью искусственным сердцем

![]() Google обновила Gemini 2.0 Flash: новый уровень фоторедактирования с помощью ИИ

Google обновила Gemini 2.0 Flash: новый уровень фоторедактирования с помощью ИИ

![]() Возраст, в котором мозг начинает терять остроту: новое исследование

Возраст, в котором мозг начинает терять остроту: новое исследование

![]() PlayStation 5 Pro получит улучшенную графику благодаря новому апскейлеру

PlayStation 5 Pro получит улучшенную графику благодаря новому апскейлеру